这波操作直接把AI成本打下来了,中小企业和个人开发者终于能"用得起"好模型了。

昨天刷到OpenAI发布GPT-5.4 mini和nano的消息时,我第一反应是:这帮人是不是疯了?

0.75美元每百万token的输入价格,4.5美元的输出价格——这相当于GPT-5.4满血版的1/3成本。要知道,之前用GPT-5.4跑个大项目,一天烧个几百美元很正常。现在呢?同样的预算能跑三倍的任务。

我专门去看了技术文档和测试数据,说实话,有点被震撼到了。

mini的性能居然这么猛?

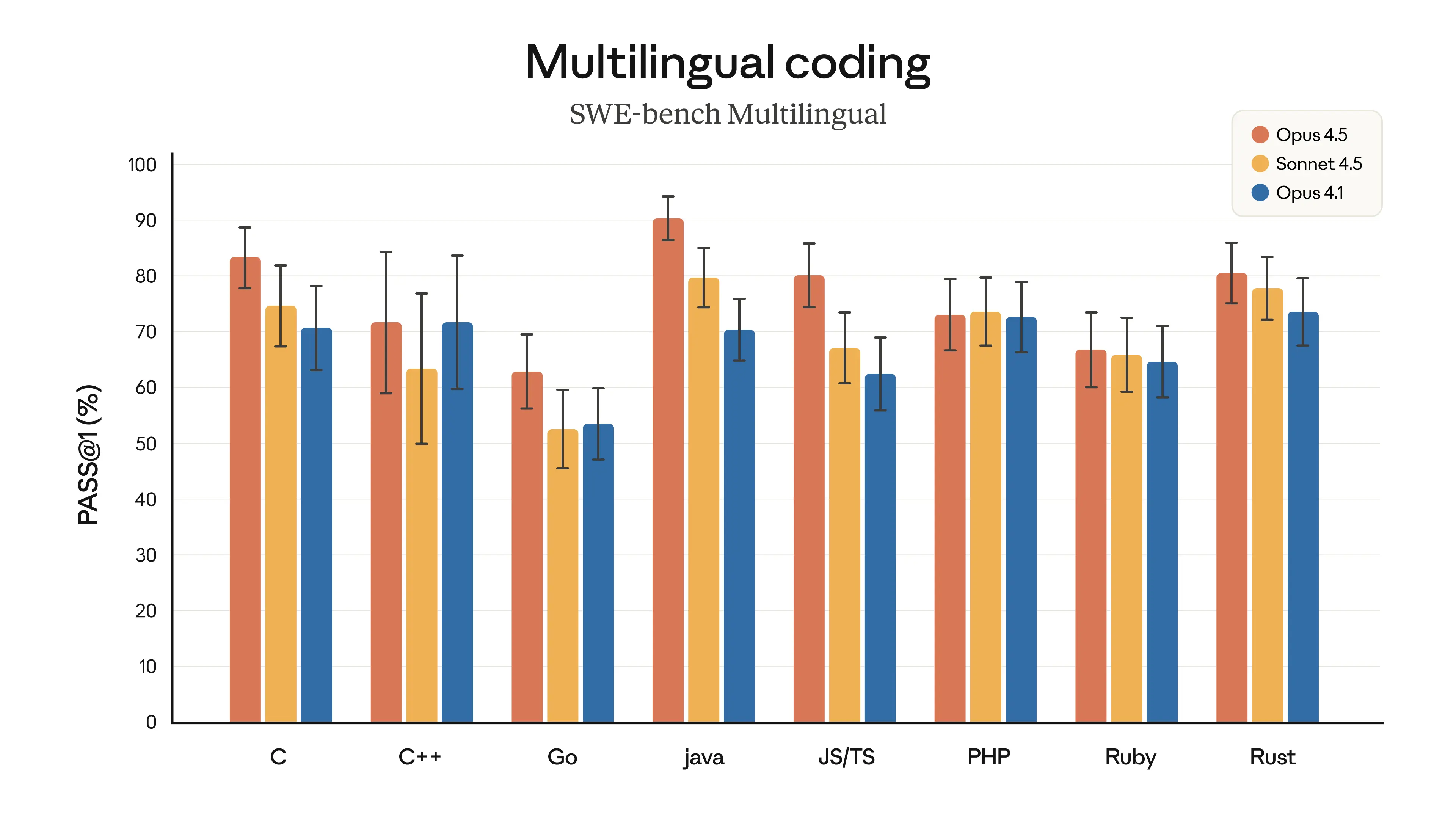

先别急着觉得"便宜没好货"。GPT-5.4 mini在几个关键指标上,基本都快追上满血版了:

编码能力(SWE-Bench Pro): mini得分54.4%,满血版GPT-5.4是57.7%——差距不到4个点 计算机操作(OSWorld-Verified): mini拿到72.1%,满血版75.0%,上一代GPT-5 mini才42.0% 博士级科学推理(GPQA Diamond): mini达到88%,满血版93%

更夸张的是,速度比上一代GPT-5 mini快了整整2倍。

我看了几个技术博主的实测视频,有个做代码辅助的开发者说,他用mini跑了一个中型项目的重构任务,之前用GPT-5 mini要15分钟,现在7分钟搞定,而且代码质量明显更好。

还有个做数据分析的用户反馈,之前用Claude 4.6 Opus跑大规模数据清洗,一天的成本要30多美元,换成GPT-5.4 mini后,成本降到3美元出头——整整便宜9倍。

nano是给谁用的?

GPT-5.4 nano更狠,输入0.2美元/百万token,输出1.25美元/百万token。

这个价位已经比很多国产大模型还便宜了。但它的定位很明确:高频低复杂度任务。

比如:

大批量文本分类 数据提取和格式转换 简单的客服问答 内容审核和过滤

有个做电商的朋友告诉我,他们每天要处理10万条用户评论,做情感分析和关键词提取。之前用GPT-4o-mini,一天的成本要200多美元,现在换成nano,成本直接降到50美元以内。

而且速度更快,延迟更低,用户体验也更好。

OpenAI在打什么算盘?

我觉得OpenAI这波操作,是在下一盘很大的棋。

他们提了一个概念叫**"子智能体范式"**:

用旗舰模型(比如GPT-5.4)做规划和决策,然后调度mini/nano模型并行执行具体任务。

在他们的Codex产品里,mini只消耗GPT-5.4配额的30%,但能完成大部分执行层的工作。这样一来,整体成本能降低60%-70%。

这个架构让我想起互联网公司的技术栈:有做决策的"大脑",也有干活的"手脚"。之前AI领域的问题是,"手脚"要么太贵,要么太蠢。现在mini/nano既便宜又能干,这个范式才真正跑通了。

但mini也有短板

别误会,我不是在无脑吹。mini在一些场景下确实不如满血版。

最明显的就是长上下文处理能力。在128K-256K窗口的MRCR v2测试中,mini和满血版的差距达到40个百分点以上。

什么意思呢?如果你要让它读一本50页的技术文档,然后基于整个文档做复杂推理,mini可能会"记不住"前面提到的一些细节。

还有一点,mini的复杂任务规划能力还是比满血版弱。如果你的任务需要多步骤推理、反复调整策略,满血版会更稳。

所以,选哪个模型,要看你的具体需求:

日常对话、代码补全、简单任务 → mini足够了 大规模数据处理、高并发场景 → nano最划算 长文档分析、复杂项目规划 → 还是得用满血版

这对中国大模型意味着什么?

说实话,看到这个价格,我有点担心国内厂商。

0.75美元的输入价格,换算成人民币才5块多钱每百万token。这个价位已经比很多国产模型的API还便宜了,但性能却接近GPT-5.4满血版。

之前国产模型最大的优势就是性价比,现在OpenAI直接把这个优势抹掉了。

我最近测试了几个国产模型,比如Qwen、DeepSeek、GLM,它们的最新版本性能确实不错,和GPT-5 mini差距不大。但在价格上,现在很难跟mini/nano竞争。

唯一的机会可能在于:

国产模型的开源版本,可以本地部署,完全免费 特定领域的优化,比如中文理解、行业知识库 合规和数据安全,很多企业确实需要本地化部署

对普通用户有什么影响?

如果你是ChatGPT的免费用户,现在刷新页面,大概率已经在用mini了。

OpenAI把mini开放给了所有用户,包括免费用户和Go订阅用户。很多人可能没注意到,但你会发现回复速度快了,代码处理更稳了,整体体验更流畅了。

我测试了一下,让它写一个Python爬虫脚本,处理一个中等规模的数据集。之前用GPT-4o,经常会出现小错误,需要反复修改。现在用mini,一次生成的代码基本能直接跑,而且逻辑更清晰。

如果你是开发者,那更要关注API的变化。现在的定价策略,让中小项目也能用得起高质量的AI服务了。

我的判断

GPT-5.4 mini/nano的发布,可能是2026年AI领域的一个分水岭。

它标志着AI应用真正从"奢侈品"变成了"日用品"。之前很多想法因为成本太高而搁置的项目,现在可以重新考虑了。

比如:

用AI做大规模数据清洗和标注 给每个客服配一个AI助手 为中小企业开发定制化的AI工具

这些场景,之前要么成本太高,要么性能不够。现在,终于有解了。

所以,如果你还在犹豫要不要把AI集成到自己的工作流程里,现在可能是最好的时机。