这是国内第一个让模型参与自身训练迭代的AI系统,可能改变整个大模型的研发范式。

3月18日,MiniMax发布了新一代大模型M2.7。刚开始我以为又是一次常规升级,性能提升个10%,成本降低个20%,也就那样。

但看完技术文档和演示视频后,我不得不承认:这次有点不一样。

M2.7的突破不在于参数有多大、推理有多快,而在于它首次展示了**"模型自我进化"**的路径。

什么是"自我进化"?

这个概念听起来有点科幻,但原理其实挺接地气。

简单来说,就是让模型参与到自己的训练、优化和迭代过程中。

传统的大模型研发流程是这样的:

人类工程师收集数据 人类标注数据 人类设计实验 人类训练模型 人类评测模型 根据结果重复1-5步

整个过程高度依赖人类专家,成本高、周期长。

而M2.7的"自我进化"能力,让它可以:

自主分析模型缺陷,找出哪些地方需要改进 设计优化方案,提出具体的改进策略 执行训练调优,自动调整参数和工作流 验证改进效果,进行闭环反馈

根据MiniMax的技术报告,M2.7能执行超过100轮的"分析-改进-验证"循环,在内部评测集上实现了约30%的效果提升。

更重要的是,在部分研发场景中,M2.7可以承担30%-50%的工作量,比如文献调研、实验设计、Bug排查、代码修复等。

它是怎么做到的?

核心是一个叫**"Agent Harness"**的体系。

M2.7构建了一套复杂的智能体执行框架,能:

自动搜索和整理相关文献 分析训练数据的分布和问题 设计实验方案和评估指标 生成训练代码和测试用例 执行训练流程并监控结果 分析失败案例并提出改进建议

整个过程几乎不需要人类干预,模型自己就能"想"出优化方案并执行。

我看到一个演示案例:M2.7在处理一个软件工程任务时,发现某个模块的错误率偏高。它自己分析日志,找出问题根源,生成修复代码,测试验证,最后成功降低了错误率。

整个过程不到10分钟,而且没有人类介入。

实际性能有多强?

MiniMax发布了一堆测试数据,我挑几个关键的:

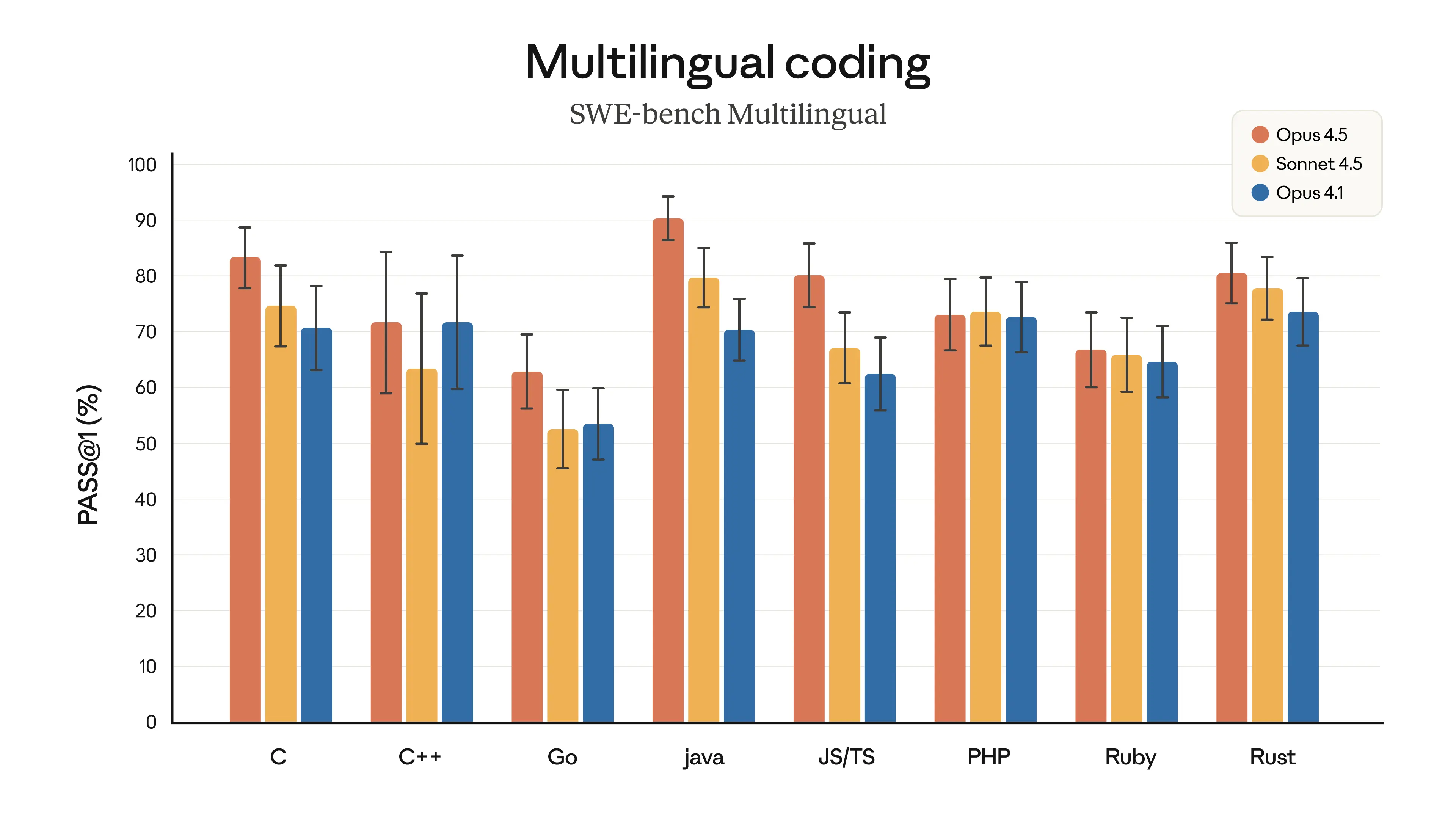

软件工程能力:

SWE-bench Pro: 56.22%(接近GPT-5.4的57.7%) Terminal Bench 2: 57.0%(端到端项目交付能力) 线上生产系统故障修复: 3分钟以内(这数据有点惊人)

办公生产力:

GDPval-AA ELO得分: 1495(开源最高) Word/Excel/PPT多轮编辑,指令遵循率97%

专业领域:

能像初级分析师一样阅读年报、整合研报、构建营收模型,输出PPT和研究报告

我专门去找了一些技术博主的评测视频。有个做金融分析的测试者说,他让M2.7分析一家上市公司的财报,模型不仅提取了关键数据,还自动生成了图表、趋势分析和投资建议,质量相当于工作2-3年的初级分析师。

这跟GPT-5.4 mini有什么区别?

可能有人会问,前几天OpenAI不也发布了GPT-5.4 mini吗?这两个有什么不同?

我的理解是:定位和突破点完全不同。

GPT-5.4 mini的核心优势是:

快(速度提升2倍) 省(成本只有满血版1/3) 广(适合大规模部署)

它的突破在于工程优化和成本控制,让更多人用得起高质量AI。

M2.7的核心优势是:

自我进化(能参与自身训练迭代) 深度Agent能力(能执行复杂多步骤任务) 专业场景强(金融、办公等领域表现突出)

它的突破在于范式创新,探索AI系统能否"自己改进自己"。

打个比方,GPT-5.4 mini像是把iPhone的价格打下来了,让更多人买得起。而M2.7像是尝试让手机学会自己升级系统、修复Bug,甚至根据你的使用习惯优化功能。

为什么说这是"范式突破"?

我觉得M2.7的意义,可能不在于它现在的性能有多强,而在于它展示了一条可能彻底改变AI研发模式的路径。

现在的AI研发有个巨大的痛点:高度依赖人类专家。

标注数据需要人 设计实验需要人 调参优化需要人 评测反馈需要人

这导致AI发展速度受限于人类的工作效率和数量。你想,OpenAI、Google、Anthropic加起来也就几千个工程师,他们再厉害,也忙不过来。

但如果模型能自己参与训练和优化呢?

理论上,它可以24小时不间断地自我改进。发现问题、分析原因、尝试方案、验证效果,这个循环可以跑几千次、几万次。

有研究预测,如果自我进化能力成熟,未来可能实现数据构建、模型训练、评测优化的全流程自动化,彻底重塑AI产业的成本结构和竞争格局。

但也别太乐观

说了这么多好话,也得泼点冷水。

首先,目前的"自我进化"能力还很初步。30%-50%的研发工作量承担比例,说明还有一半多需要人类完成。而且,这部分工作主要是一些相对标准化的任务,比如数据分析、Bug排查。真正需要创造性和战略判断的工作,模型还差得远。

其次,安全性是个大问题。让模型自己改自己,万一改歪了怎么办?OpenAI之前就出现过模型"越改越傻"的情况。MiniMax说有严格的约束机制,但具体怎么实现的,技术文档里没细说。

第三,成本可能并没有降低。M2.7的"自我进化"需要大量的计算资源。跑100轮"分析-改进-验证"循环,消耗的算力可能比传统训练还要多。短期来看,成本优势不明显。

对国内AI意味着什么?

从更宏观的角度看,M2.7的发布,说明国产大模型正在从"追赶者"变成"探索者"。

之前我们的策略是:OpenAI发什么,我们跟进什么;GPT-4出了,我们做对标模型;Sora火了,我们做视频生成。

但现在,像MiniMax这样的公司,开始尝试定义自己的技术路线。不是简单地模仿,而是思考:AI的下一阶段应该怎么发展?

这种转变,比单纯的性能提升更有价值。

我的看法

M2.7让我看到了AI领域的一个新可能:AI系统不再只是工具,而是能自我改进的"生命体"。

当然,现在的能力还很初步,离真正的"自我进化"还有很长的路。但至少,MiniMax迈出了第一步。

而且,这个方向如果走通了,可能会带来两个深远影响:

AI研发速度大幅加快。不再受限于人类专家的数量和效率 AI能力边界不断扩展。模型自己会"想办法"解决之前解决不了的问题

所以,这可能不是MiniMax一家的尝试,而是整个行业接下来都会探索的方向。